Les posts de l’IA ACADEMIE – 2022 2025

Dall-e, l’IA générative qui dessine ce que vous écrivez !

Comme nous l’annoncions régulièrement dans les formations et les conférences de l’IA ACADEMIE, L’IA développée par OPEN AI et dénommée DALL-E, contraction du fameux peintre et du robot Disney, est enfin ouverte à tous les internautes. Gratuite au démarrage et payante ensuite, mais disponible. Plus de liste d’attente. On peut en disposer immédiatement, dès son inscription. Comment ça marche ?

On écrit une question et plusieurs images créées par l’IA sont proposées. Celle du petit prince de ce post a été obtenue en écrivant : « petit prince de Saint-Exupéry qui dessine ». Les conséquences vont être significatives sur les droits d’auteurs, avec de probables répercussions sur les métiers du design, du graphisme, de l’architecture d’intérieur et de la communication pour lesquels on peut s’attendre à un rééquilibrage progressif de la chaîne de valeur.

Comment l’évolution technologique peut altérer les performances ?

Les salons spécialisés en data sciences regorgent de nouvelles solutions technologiques, et des accords se multiplient entre les entreprises et les géants du Cloud. Les architectures se complexifient, les algorithmes deviennent plus puissants et des data lab croissent au sein des entreprises. Le nouveau langage de la data science, au-delà du Deep learning et du Big Data devenus faussement familiers, s’enrichit avec de nouveaux enfants comme les réseaux antagonistes, le MLops ou le lake house. Mais combien de lecteurs de ce post sauraient les définir ?

Il en est de même pour la plupart des consultants des sociétés de conseil qui n’ont pas reçu de formation sur ces fondamentaux et qui n’ont pas toujours de data scientist ou de data engineer sous la main pour être crédibles vis-à-vis de leurs clients sur des sujets IA ou cloud. Même combat chez les directeurs métiers dans toute entreprise pour choisir le bon prestataire.

Plus une organisation avance sur ces technologies et plus l’écart risque de se creuser entre ses équipes métiers et les prouesses technologiques de son data lab. Une formation d’une durée raisonnable, qui ne fera pas de ravages dans son agenda, ne transformera pas un cadre ou un consultant métier en codeur, ce qui n’est pas sa finalité, mais le rendra plus performant sur ces nouveaux sujets.

L’Intelligence Artificielle dans les services publics

A la demande du Premier ministre, le Conseil d’État a publié au mois d’août 2022 une étude qui plaide pour un déploiement de l’intelligence artificielle dans les services publics, au service de l’intérêt général et de la performance, anticipant ainsi le prochain cadre réglementaire européen. Cette étude s’est effectuée à travers 7 lignes directrices : la primauté humaine, la performance, l’équité et la non-discrimination, la transparence, la cybersécurité, la soutenabilité environnementale et l’autonomie stratégique.

Pour cela, la France doit disposer des ressources et de la gouvernance afin de former les dirigeants publics et se doter des ressources nécessaires. L’étude préconise de renforcer le département ETALAB de la direction interministérielle du numérique et du coordonnateur national pour l’intelligence artificielle, en lien avec l’intervention de l’Agence nationale de la cohésion des territoires. L’étude propose également que la CNIL soit le représentant national de la Communauté Européenne pour la prochaine directive sur l’IA, l’IA ACT, compte tenu de son rôle déterminant sur la protection des données.

A cet effet, le Conseil d’Etat préconise une transformation profonde de la CNIL en autorité de contrôle nationale responsable de la régulation des systèmes d’IA, notamment publics, pour assurer la protection des droits et libertés fondamentaux avec un enjeu d’innovation et de performance.

L’aversion des dirigeants pour leur propre formation.

Des expériences, menées il y a une vingtaine d’années par les deux chercheurs Frank Keil et Leonid Rozenblit, ont montré que l’utilisation fréquente d’un objet familier crée un sentiment de compréhension du fonctionnement de cet objet. Quand on demande à quelqu’un comment fonctionne une fermeture éclair, la plupart des personnes interrogées répondent par l’affirmative. Ces inventions nous sont tellement familières que leur fonctionnement nous parait évident. Mais dès qu’il faut les analyser et les expliquer en détail, l’exercice se révèle beaucoup plus complexe. La grande majorité des personnes ayant répondu positivement aux deux psychologues durent convenir qu’elles ne savaient pas exactement comment marchait une fermeture éclair. Les deux chercheurs ont appelé ce phénomène : illusion de profondeur explicative, ou en anglais : illusion Of Explanatory Depth (IOED). On peut penser qu’il en est tout autrement pour un sujet complexe. Erreur, car s’il est fortement médiatisé, il nous devient tout aussi familier. Prenons l’exemple de l’Intelligence artificielle.

La lecture ou l’écoute d’informations répétées sans cesse sur le net, dans la presse, à la télévision ou à la radio, rendent des sujets comme le Machine Learning ou le Deep Learning étonnamment familiers. Cela crée un sentiment de compréhension erroné à un niveau supérieur qui induit des sentiments de compréhension inexacts sur les niveaux inférieurs, provoquant une illusion de compréhension de ces sujets. Dans un article paru dans le magazine politique britannique, The New Statesman, l’essayiste Ian Leslie a repris le principe d’illusion de profondeur explicative en se servant de l’exemple des côtes anglaises. Vues d’avion, elles paraissent conformes aux cartes géographiques. Mais en y regardant de plus près, il devient beaucoup plus difficile de retrouver le dessin des cartes tant leur découpage est complexe.

Plutôt que de reconnaître cette lacune et rechercher à la combler, nous avons tendance, face à cette complexité, à nous mentir à nous-mêmes et nous rejetons souvent les informations qui ne rentrent pas facilement dans nos schémas de pensée.

Si nous revenons sur l’Intelligence artificielle, nous constatons qu’un grand nombre de dirigeants et de managers métier en entreprise ne considèrent pas utile de se former, alors qu’il existe des programmes d’acculturation courts et efficaces qui (sans les transformer en codeurs, ce n’est pas leur finalité) leur permettraient de mieux comprendre les éléments de langage et le fonctionnement des principaux outils qui utilisent intelligemment les data. Cela améliorerait sensiblement l’intégration de l’IA dans leur entreprise.

Mais l’IOED a la peau dure, car les études montrent que seulement 25 % des entreprises françaises utilisent réellement l’IA dans leur stratégie globale.

L’IA et l’imprévu

Les IA conscientes n’existent « toujours » pas. Nos systèmes d’IA actuels sont formatés pour prévoir l’inconnu en examinant le présent et le passé. L’erreur de visée est bien prise en compte, mais à condition qu’elle obéisse également à des règles mathématiques. Les fameux « cygnes noirs » dont la crise des subprimes, la pandémie, la guerre et l’inflation sont de funestes spécimens, nous échappent.

A trop se concentrer sur le connu et le répété, nous manquons de réactivité et de la créativité nécessaire lorsque l’improbable et l’extrême nous surprennent. Les IA actuelles montrent leurs limites car seules les régularités et les singularités « raisonnables » sont à leur portée. La réelle complémentarité entre l’IA et l’humain consisterait à déléguer les prévisions à des algorithmes dans l’univers du probable, ce qu’ils feront mieux que nous, et nous concentrer sur le comment nous préparer aux ruptures brutales d’un monde volatil.

Pourquoi GPT3 a-t-il autant de succès ?

Depuis qu’OPEN AI a ouvert son IA GPT3 au public sous la forme d’un outil conversationnel appelé ChatGPT, les medias ne parlent plus que de lui, le présentant comme une véritable révolution dans l’utilisation du langage naturel. Ce qui est probablement le cas, même s’il présente encore quelques failles (ça reste une IA faible, ne l’oublions pas) qu’OPEN AI ne cache pas en livrant ChatGPT au public. Mais comme le font remarquer plusieurs spécialistes, d’autres outils, comme Google Bert par exemple, existent et sont basés sur les mêmes supports technologiques.

Ces outils s’appuient sur ce que l’on appelle des « transformers » (rien à voir avec les robots métamorphes). Il s’agit d’algorithmes de réseaux de neurones spécifiques récemment inventés et sans cesse perfectionnés. Ils améliorent sensiblement les réseaux de neurones récurrents classiques pour répondre à des questions (ex : speech to text) ou traduire des documents.

Basés sur le principe des réseaux encodeurs/décodeurs, leur grand avantage consiste à utiliser des techniques « d’attention », une technologie qui permet de prendre en compte finement les interactions entre chaque composante d’une question. GPT3 n’est pas le seul à faire cela, mais il possède un atout fondamental. Sa performance est alliée à la taille de sa base d’entraînement, avec 175 milliards de paramètres, là ou Bert n’en compte que 335 millions. On parle même d’une nouvelle version de GPT4 qui compterait 280 milliards de paramètres. Même si le nombre de paramètres n’est pas nécessairement un gage de performance, on peut conclure que dans le monde de l’IA, Big seems beautiful !

L’IA générative et les agents conversationnels

L’IA générative commence à être utilisée par les entreprises pour le SEO, la création et l’envoi de courriels ou la génération de contenus. Un autre cas d’usage, plus technique et dont on parle moins, est l’amélioration des agents conversationnels. Les chatbots, dont la réputation n’est pas au beau fixe, et actuellement peu utilisés (moins de 10 % des interactions clients), fonctionnent aujourd’hui soit en basique avec des algorithmes classiques comme les plus proches voisins, soit au mieux avec du Deep Learning, au moyen de réseaux de neurones récurrents sequence to sequence, LSTM (Long Short term Memory) plus performants car capables de posséder une mémoire.

Chaque étape du calcul du réseau garde en mémoire les étapes précédentes, ce qui améliore la performance du réseau. Mais les nouvelles techniques d’IA générative, utilisées par ChatGPT ou BERT et appelées « transformers » analysent beaucoup plus finement les interactions entre chaque mot d’une phrase et permettent d’améliorer considérablement les performances des réseaux récurrents. De plus, ces algorithmes sont disponibles en open source. Par exemple, pour les spécialistes, la suite Anaconda avec conda-forge permet d’y accéder en python. Seules quelques entreprises en ont compris l’intérêt et ont déjà entamé cette mue. Si le marché suit, ce saut technologique pourra accroître l’intelligence de l’automatisation de la relation client.

La prochaine réglementation européenne de l’IA sur les assurances

Rappelons que l’IA ACT va réguler les systèmes d’IA différemment selon le niveau de risque. Les systèmes d’IA classés en risque élevé (ou à haut risque) seront soumis à plusieurs obligations liées à la gestion des risques, la gouvernance des données, la documentation, la transparence et la sécurité. Ils devront être déclarés à l’UE et obtenir un marquage CE pour pouvoir être mis en production. La république tchèque (actuelle présidente du Conseil européen) a produit une dernière version de l’IA ACT qui pourrait enfin conduire à une approbation en Commission plénière avant la fin de l’année. Elle a invité les délégations à formuler leurs dernières remarques, avant que le texte soit soumis au Coreper le 11 novembre 2022 pour une discussion prévue le 18 novembre 2022.

Le texte de la Présidence tchèque revoit notamment les conditions d’inclusion de certains services d’assurance dans la liste des cas d’utilisation à haut risque de l’IA. Les IA concernant les assurances auto et multi risque habitation (fixation des primes, souscription et évaluation des sinistres) seraient exclues des risques élevés. Selon la dernière version de l’IA ACT, feraient l’objet d’un risque élevé les systèmes d’IA utilisés pour l’évaluation des risques liés aux personnes physiques et la tarification dans le cas de produits d’assurance vie et d’assurance santé qui, s’ils ne sont pas dûment conçus, développés et utilisés, peuvent avoir de graves conséquences sur la vie et la santé des personnes, y compris l’exclusion financière et la discrimination.

L’IA ACT est-il nécessaire ?

En complément du RGPD déjà en place et de l’IA Act, approuvé par le Conseil Européen le 6 décembre 2022, actuellement en discussion au parlement et qui a pour objectif de sécuriser les systèmes d’IA, voici une nouvelle publication par la CE de deux propositions de directives afin de faciliter les actions civiles en réparation d’un éventuel dommage subi par une IA. Ce paquet de règles peut paraître très lourd, mais a-t-on pris la mesure des dérives de l’IA en l’absence d’une régulation efficace ?

A-t-on envie d’un « Black Mirror » dans 10 ans avec des drones qui s’écrasent impunément sur des passants, des voitures autonomes qui renversent des piétons, des robots de compagnie qui s’en prennent aux personnes âgées, des amis virtuels et des vidéos ciblées qui influencent nos comportements, des manipulations des marchés financiers, des discriminations à l’embauche, sans savoir pourquoi, comment, et par qui ? Nous ne sommes pas encore menacés par une IA forte qui dépassera peut-être un jour l’intelligence humaine, mais nous sommes déjà exposés à un risque de dérive non négligeable avec l’IA d’aujourd’hui. Aussi, bien que la contribution de l’IA consiste à fonctionner de façon autonome, la supervision humaine, incarnée par des outils réglementaires, n’est-elle pas essentielle ?

Data scientist ou data engineer ?

La recherche de profils tech qualifiés reste en 2023 un défi majeur pour les RH. Les compétences les plus recherchées sont les algorithmes de Machine Learning et de Deep Learning, ainsi que leur mise en production à partir d’architectures informatiques de plus en plus complexes et de données de plus en plus massives. Ces technologies sont couvertes par des formations de data engineers et de data scientists. En synthèse, les premiers préparent les infrastructures de données tandis que les seconds les exploitent pour concevoir des algorithmes.

Mais dans la pratique, la séparation des tâches n’est pas aussi franche, car les data engineers peuvent être amenés à modéliser des données et les data scientists doivent parfois collecter de larges volumes de données non structurées. La zone de recoupement va probablement accroître, d’une part face aux difficultés de recrutement en France compte tenu de l’attractivité des rémunérations de ces métiers à l’étranger, notamment aux Etats Unis, au Canada et en Suisse, et d’autre part en raison de la pression croissante des besoins des organisations.

Ce constat devrait permettre d’ouvrir une réflexion sur l’intérêt de développer des cursus de formation hybride qui allient les processus de collecte et de stockage des données à la conception d’algorithmes pertinents.

Comment détruire l’expérience client d’une Banque avec un robot basique, et comment l’enrichir avec l’IA Générative

Combien de fois avons-nous envoyé un message à une banque qui, sans attendre, nous a répondu que notre demande sera traitée rapidement en s’engageant sur un délai ? Le message est souvent enrobé de formules rassurantes : « cher client, chère cliente, confiance, merci, nous nous engageons », afin de nous faire oublier que c’est une machine basique qui répond. Le problème, c’est que le conseiller a du mal à suivre. On ne peut pas le lui reprocher, compte tenu de la pression exercée par le dit message du fait de sa systématisation.

La conséquence, c’est que les clients réagissent mal, par forcément tout de suite, mais de manière souterraine, dans la durée. Ils ferment leurs comptes et transfèrent progressivement leurs avoirs sans trouver forcément mieux ailleurs. Les Net Promoter Scores (NPS), déjà pas toujours au beau fixe dans ce secteur d’activité, se dégradent et l’expérience client en pâtit. Un engagement mécanisé et sans nuance entraîne pression interne et attrition client.

Imaginons à présent, un agent conversationnel nouvelle génération issu du mariage de ChatGPT et de la base de questions réponses de la banque en question. Soit un agent conversationnel n fois plus efficace que les chatbots actuels que l’on a tendance à bouder. Ce robot dopé à l’IA générative répondrait finement, prendrait en charge directement certaines réponses et si des éléments lui manquent, alerterait le conseiller en les lui réclamant pour ensuite répondre efficacement à sa place, lui permettant de se concentrer sur ses ventes.

Non, ce n’est pas de la science-fiction. C’est ce qui nous attend, et tant mieux. L’automatisation ne détruit pas l’expérience client si elle est bien faite. Un tel robot pourra réellement exister dès que les banques auront investi suffisamment dans les techniques d’IA Générative.

Mais nous retombons comme toujours sur l’absence de culture IA chez la plupart des dirigeants qui est un frein à l’utilisation du plein potentiel de l’IA. Donc, encore longue vie au chatbots idiots et aux réponses toutes faites ? A voir dans le contexte des nouvelles IA génératives de plus en plus immersives qui, au-delà de l’atteinte d’un meilleur résultat, stimuleront peut-être l’intérêt des décideurs sur le « comment on y parvient ».

L’IA, c’est quoi exactement (une pause sur les définitions) ?

Si on définit l’IA de manière déductive, en partant du général vers le particulier, on obtient plusieurs définitions très générales qui ne permettent pas de faire la différence avec un programme informatique standard. Citons par exemple la définition de l’un de ses auteurs Marwin Minsky : « l’IA est la construction de programmes informatiques qui s’adonnent à des tâches qui sont, pour l’instant, accomplies de façon plus satisfaisante par des êtres humains, car elles demandent des processus mentaux de haut niveau tels que : l’apprentissage perceptuel, l’organisation de la mémoire et le raisonnement critique. » Une calculette ne fait-elle pas cela ?

Si, au contraire, on définit l’IA de façon inductive, en partant du particulier vers le général, donc en listant ses composantes actuelles, il est plus facile de comprendre ce qu’elle est et ce qu’elle n’est pas.

1 — Prendre une décision à partir d’un empilement de règles logiques, c’est de l’IA.

2 — Prédire si on va payer ou non son crédit, si un client va quitter sa banque, si une machine va tomber en panne avec des scores statistiques établis à partir de données simples comme des nombres ou des modalités (profession, genre, pays, mots…), ce qu’on désigne sous le vocable de « données structurées », c’est de l’IA.

3 — Interpréter des données plus complexes appelées données non structurées, comme des notes manuscrites ou des images pour identifier une tumeur, reconnaitre un individu ou un objet, à partir d’algorithmes imitant le fonctionnement de nos neurones, c’est aussi de l’IA.

4 — Comprendre des données également non structurées comme des sons, des textes, des vidéos ou des séries complexes pour répondre à une question ou traduire un document, à partir d’algorithmes imitant le fonctionnement de nos neurones, c’est encore de l’IA.

L’IA évoquée au point 1 s’appelle IA symbolique. Les IA évoquées aux points 2,3 et 4 s’appellent aujourd’hui le Machine Learning. Les IA évoquées aux points 3 et 4 s’appellent également le Deep Learning et forment donc une partie du Machine Learning. Un algorithme d’IA permet d’effectuer une prédiction ou une estimation. On n’est jamais sûr à 100 % du résultat. Il peut traiter des cas qu’il n’a jamais rencontré précédemment en effectuant une approximation. L’erreur peut être minime, admissible et sans impact, mais elle existe. Dans le cas contraire, si un algorithme ne permet aucune erreur, ce n’est pas de l’IA. Par exemple, le calcul du PGCD ou les dispositifs de RPA (Robotic process automation) qui automatisent le fonctionnement harmonieux et synchronisé de plusieurs programmes ou logiciels qui travaillent ensemble mais sans effectuer aucune prévision.

On dit qu’un algorithme d’IA apprend car il est construit à partir d’un échantillon, appelé échantillon d’entraînement, pour traiter une fois conçu des cas qui ne figuraient pas dans cet échantillon. Par exemple, un score de crédit va prédire que selon son profil, monsieur Dupont est un mauvais payeur potentiel alors que le profil de Monsieur Dupont ne figurait pas dans l’échantillon ayant servi à construire l’algorithme. On désigne par inférence cette propriété de prolonger une connaissance établie à partir du connu sur quelque chose d’inconnu.

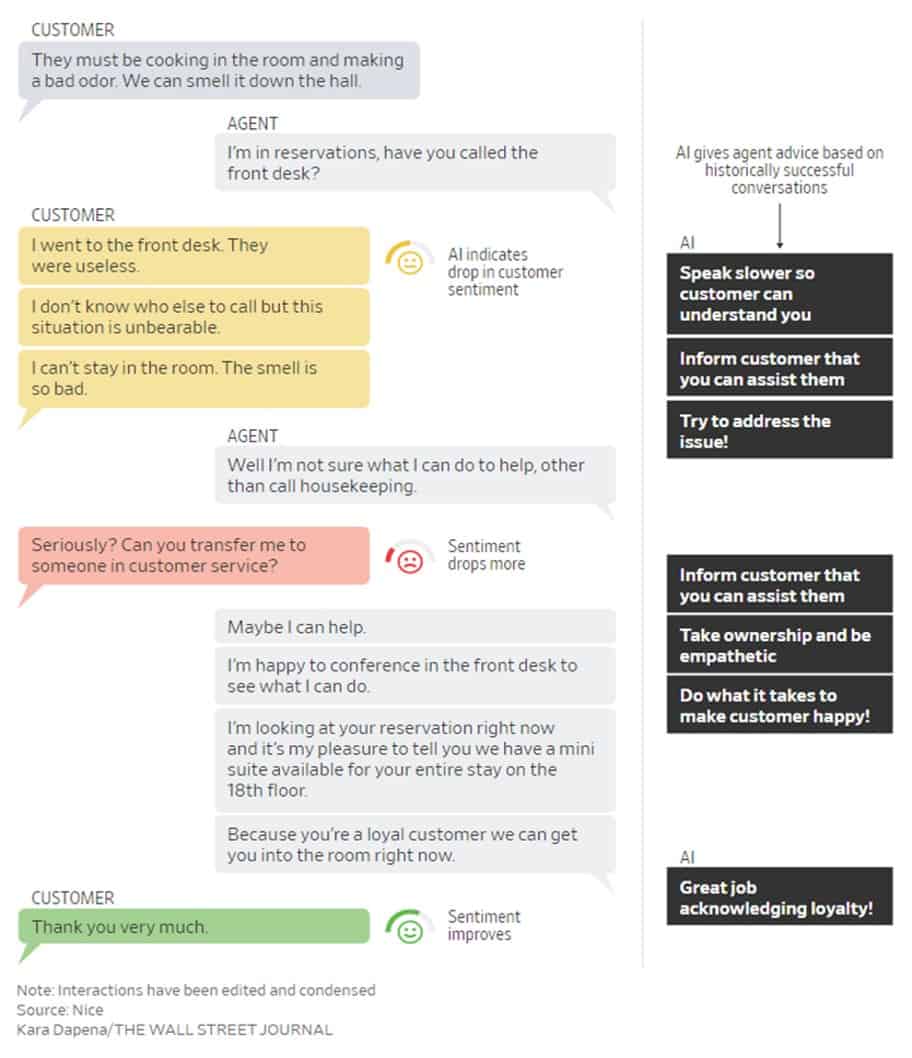

Quand les robots guident les téléconseillers

L’analyse des sentiments est devenue l’un des nouveaux domaines les plus avancés du service client.

Nice Ltd, une société d’analyse de logiciels qui compte notamment parmi ses clients American Airlines Group Morgan Stanley, Comcast et Walt Disney Co, a mis au moins un dispositif d’analyse de sentiments qui aide à déterminer ce que veulent les clients à partir de ce qu’ils disent et comment ils le disent.

Cette technologie analyse les sentiments des clients en s’appuyant sur les mots et le contexte dans lequel ils sont utilisés, ainsi que sur les changements de ton et de cadence.

Le robot guide et dirige le téléconseiller dans son parcours client. En voici un exemple sur la progression d’une conversation entre un client d’hôtel et un agent de réservation.

Les IA génératives comme ChatGPT impacteraient 80 % des métiers ?

ChatGPT effectue énormément de tâches avec succès, de la génération de contenu à la réussite d’examens difficiles. Face à son efficacité, la question suivante se pose : lorsqu’il sera devenu complètement fiable, quels métiers sa nième version remplacera-t-elle ? OPENAI, les créateurs de GPT3, 4, ChatGPT et Dall-e, se sont penchés sur ce sujet et le résultat de leur étude devrait selon nous déclencher plus de sourires que de peurs. Ils concluent que 80 % de la masse salariale américaine serait impactée par ces IA, dont 19 % des métiers à hauteur de 50 %.

Comment ont-ils réalisé cette étude ? Peut-être l’ont-ils demandée à ChatGPT. On ne peut pas s’empêcher de penser aux études des grands cabinets de conseils qui fournissaient il y a quelques années des listes d’emplois menacés à court terme, prédictions souvent contradictoires et qui n’ont pas été suivies d’effets.

Le plus surprenant dans les conclusions d’OPENAI, c’est une liste de seulement 34 métiers épargnés pas l’IA. Cette liste stupéfiante comprend des métiers dont le commun des mortels ignorait probablement l’existence, comme les boulonneurs de toits dans l’industrie minière, les verseurs de métaux ou les régleurs de viande. La liste est d’une précision redoutable car on y trouve les aides peintres et les aides menuisiers, mais ni les peintres ni les menuisiers. Cela signifie que des machines commanderont des aidants. Y figurent également les réparateurs de matériaux réfractaires, mais en excluant les briqueteurs-maçons qui eux seraient donc condamnés. Si vous avez des briqueteurs-maçons dans votre entourage, prévenez-les vite. Nous avons le plus grand respect pour OPENAI dont nous suivons les travaux avec intérêt depuis leur création, mais alors là… Oui, bien sûr, l’IA impactera des métiers, mais n’oublions pas nos capacités de résilience et d’innovation. Utilisons plutôt ces IA pour nous rendre encore meilleurs.

Il est fondamental de conserver une longueur d’avance pour que les formations sur l’Intelligence Artificielle soient efficaces.

Depuis la sortie des versions successives de ChatGPT, les articles et les interventions se multiplient, souvent chez des spécialistes autoproclamés ou dans des tables rondes où des personnalités donnent leur opinion sur ces sujets sans en connaître les fondements. Il en est de même avec le prochain règlement européen de l’IA que l’on semble découvrir alors que le premier projet de texte est paru en avril 2021. Ces informations diffuses, partielles et parfois erronées, produisent de l’inquiétude et de l’anxiété.

A l’IA ACADEMIE, nous suivons les nouvelles tendances depuis leur naissance. Par exemple, l’IA ACT qui va bientôt réglementer l’IA en Europe fait l’objet d’études de notre part depuis plus de deux ans. Nous suivons les travaux d’OPEN AI, des GANs et des transformers depuis 2020. Nos formations intègrent ces sujets depuis des années sans avoir attendu la prochaine entrée en vigueur de l’IA ACT ou la récente mise à disposition pour le grand public des outils d’OPEN AI avec ChatGPT3/4 et Dall-e, ainsi que ses équivalents comme Stable Diffusion ou Midjourney.

Nous enseignons les techniques pour déceler les failles des « fakes » et comprendre à partir de quelles technologies et non quelle magie ils sont produits afin de profiter des IA génératives sans les craindre ni les subir. Nous expliquons en quoi la prochaine réglementation européenne saura appréhender les IA pour protéger nos droits fondamentaux, notre santé et notre sécurité afin d’intégrer une IA responsable et respectueuse de l’environnement et du bien commun.

Fedha, une animatrice TV virtuelle parle quelques secondes sur un média au Koweït. Faut-il s’inquiéter ?

Après les inquiétudes liées à ChatGPT et ses ravages possibles sur les emplois, largement médiatisés par le moratoire d’Elon Musk sur l’arrêt des projets IA et les prévisions catastrophistes de Goldmann Sachs et d’OPEN AI, voici une autre peur qui nous vient du Koweït où un média koweïtien, Kuwait Times, a dévoilé une animatrice virtuelle nommée Fedha, l’avatar d’une jolie femme blonde aux yeux clairs, généré par de l’intelligence artificielle. Il a suffi que Fedha parle 13 secondes en arabe dans une vidéo sur le compte Twitter du site d’actualité Kuwait News pour provoquer un grand nombre de réactions sur les réseaux sociaux, notamment de la part de journalistes qui craignent que des IA les remplacent. Il semblerait que Fedha, actuellement en test, soit destinée à présenter à terme un bulletin d’actualité sur le compte Twitter de Kuwait News, mais celui-ci n’a pas indiqué quelle serait l’IA à la base de Fedha ni le dispositif qui l’empêcherait d’halluciner comme le font les IA génératives actuelles qui peuvent créer de fausses informations. Rappelons qu’un autre avatar, Sophia, activée depuis 2016 et considérée comme le robot humanoïde le plus perfectionné, avait déjà créé ce genre de peur à l’époque sans avoir eu depuis aucun impact sur les emplois. Pour comprendre et maîtriser l’IA et ne pas avoir à la subir, apprivoisez-la.

Le Règlement Européen sur l’IA, L’IA ACT, a été voté par le parlement

Depuis la parution du premier texte de règlement sur l’Intelligence Artificielle en avril 2021, de multiples amendements et d’un accord du Conseil Européen le 6 décembre dernier, le Parlement Européen vient de donner son feu vert à l’IA Act (où l’AI Act selon) lors d’un vote jeudi 11 mai. Nous entrons à présent dans le « trilogue », phase de négociation entre le Parlement, le Conseil et la Commission européenne. On devrait pouvoir compter sur un vote final en plénière mi-juin.

Parmi les durcissements demandés par les Eurodéputés, les nouvelles IA génératives (ChatGPT, Dall-e,…), basées sur des modèles de fondation (ie : IA construites sur de grandes quantités de données non étiquetées), ont été rajoutées au règlement. Elles seront soumises à une obligation de transparence (afficher que le contenu provient d’une IA et indication du détail des données provenant de sources couvertes par le droit d’auteur).

ChatGPT va-t-il conserver son avance ?

Selon l’enquête Consumer Insights de Statista, ChatGPT est l’outil d’IA qui a le plus séduit les utilisateurs grand public aux Etats-Unis. Sur près de 1 200 personnes âgées de 18 à 64 ans et interrogées en mars/avril 2023, 21 % ont déjà utilisé ChatGPT (contre 10 % pour Dall-e, New Chat et DeepL, ce qui est déjà très bien) et 89 % d’entre elles se sont déclarées disposées à l’utiliser à nouveau.

Rappelons que ChatGPT a dépassé le seuil de 1 million d’utilisateurs en 5 jours, là où il a fallu 10 mois pour Facebook. Pour le moment, le générateur de texte d’OPEN AI est celui qui monopolise l’engouement du grand public. Mais lorsque celui-ci pourra disposer d’outils concurrents comme Bard de Google, LLaMa de Meta, avec un accès aussi fluide que celui de ChatGPT, on peut se demander si l’interface de GPT3 conservera son leadership. A suivre très prochainement.

ChatGPT sera-t-il IA Act compatible ?

Indiquer comme le prévoit l’IA ACT que toute production de contenu réalisée grâce à une IA soit clairement renseignée apportera une preuve de transparence à une population qui a déjà bien intégré que tout contenu peut être manipulé. Sur les droits d’auteur, c’est beaucoup plus complexe, car les IA génératives fonctionnent sur des données massives. C’est un de leurs principaux points forts, en plus des technologies sous-jacentes faisant appel aux réseaux de neurones « transformers » et aux « mécanismes d’attention ». Les données d’image par exemple sont celles du Web (en grand partie) où peuvent figurer des éléments soumis aux droits d’auteur, même si la création du contenu final donne une image apparemment indépendante de ses sources.

L’IA Act dans sa version provisoire, toujours en discussion, demanderait que les IA génératives identifient les sources soumises aux droits d’auteur. Cela comporte de grandes difficultés, compte tenu du nombre gigantesque de liaisons utilisées par les IA génératives à chaque prompt et donc difficilement traçables. D’où probablement la réaction du fondateur d’Open AI quand il a indiqué vouloir cesser ses activités en Europe si la régulation lui imposait des « choses impossibles ».

La solution consiste à trouver la bonne adéquation entre une innovation croissante et la maîtrise des risques, ou plutôt la réduction des risques. On ne peut atteindre cet objectif qu’en raisonnant en relatif. En d’autres termes, quels risques sommes-nous prêts à accepter pour gagner en confort ? Les moteurs de recherche nous « prennent » nos données personnelles, mais combien d’entre nous aujourd’hui refusent de les utiliser ?

De l’autre côté de la balance, des aménagements techniques peuvent certainement réduire la provenance de sources inadéquates comme l’a déjà fait GPT pour éviter des réponses indélicates, à grands renforts de labellisation, d’apprentissage supervisé et d’apprentissage par renforcement.

Nous sommes confrontés sur ces sujets à une forte accélération, tant sur l’innovation que sur la régulation. Le mercredi 24 mai, le patron d’Open AI inquiète avec son intention de quitter l’UE, et le vendredi suivant, il tient des propos plus diplomatiques en indiquant que tout est question d’équilibre. On devrait donc pouvoir parvenir rapidement à une solution.

IA et robotique

Un robot qui range vos courses : rêve ou réalité imminente ?

Et si l’IA dépassait les limites des écrans pour entrer dans vos maisons et gérer vos tâches au quotidien ? Imaginez ! Vous rentrez chez vous, et votre robot a déjà :

— scanné votre frigo,

— commandé ce qui manque,

— réceptionné vos courses,

— et tout rangé à votre place…

Ce n’est plus de la science-fiction. Des robots comme Spot (Boston Dynamics), Optimus ou Paro montrent déjà leur potentiel. Mais ce ne sont que des prototypes. La vraie question est : Quand verrons-nous une IA capable de combiner intelligence humaine et présence physique dans nos vies ?

Pour qu’une IA Générale (IAG) devienne réellement utile, elle devra avoir un corps capable de se mouvoir dans notre environnement. Fini les IA limitées aux applis et interfaces digitales : nous parlons de robots capables d’interagir avec des objets, de résoudre des problèmes concrets et d’évoluer dans le monde physique avec la même aisance que nous.

Pourquoi c’est crucial ?

Parce qu’une IA sans présence physique reste un outil, alors qu’une IA avec un corps devient un partenaire. Imaginez un robot capable de :

Remplir votre lave-vaisselle.

Prendre soin d’une personne âgée ou malade.

Effectuer des tâches logistiques complexes.

Aujourd’hui, les avancées en robotique (comme Figure One ou les robots d’OpenAI équipés de ChatGPT) montrent des progrès impressionnants, mais ces robots restent limités. La révolution viendra de la fusion parfaite entre logiciel et matériel, et selon l’IA Académie, cela pourrait arriver dans cette décennie.

IA flexible

Une IA capable de tout comprendre et s’adapter en temps réel : fiction ou réalité imminente ?

Imaginez une IA capable de :

- Discuter des secrets des mathématiques…

- Passer à une question sur l’histoire de la Grèce antique…

- Et résoudre un problème complexe au milieu de tout ça, sans jamais être reprogrammée.

C’est la promesse d’une flexibilité inédite, et ce sera un pilier fondamental de l’Intelligence Artificielle Générale (IAG). Mais où en sommes-nous vraiment ? La semaine dernière, nous avons exploré la présence physique de l’IA. Aujourd’hui, place à une question cruciale : comment rendre une IA capable de s’adapter instantanément à des environnements et tâches changeants ?

La réalité actuelle ? Encore loin du but. Les IA modernes, même les plus impressionnantes comme les systèmes génératifs (GPT ou DALL-E), ne savent pas tout faire et voici pourquoi :

- Spécialisation rigide : La plupart des IA actuelles sont conçues pour une seule tâche précise. Une IA experte en vision par ordinateur ne pourra pas comprendre une requête en traitement de langage naturel, et vice versa.

- Flexibilité limitée : Bien que les IA génératives puissent passer d’un sujet à l’autre, elles reposent sur des modèles mathématiques pré-entraînés et doivent être régulièrement mises à jour.

- Apprentissage en temps réel : Certaines IA intègrent des mécanismes d’apprentissage continu, mais elles perdent souvent leurs performances sur d’anciennes tâches en apprenant de nouvelles données.

Pourquoi la flexibilité est-elle essentielle ?

Sans flexibilité, une IAG restera bloquée dans des scénarios limités. Mais avec une vraie capacité d’adaptation :

- Elle pourra gérer des situations imprévues en temps réel.

- Passer d’un sujet ou d’une tâche à l’autre sans réentraînement.

- S’intégrer dans nos environnements complexes et dynamiques, comme un collaborateur fluide et fiable.

L’avis de l’IA Académie :

Nous sommes encore loin d’une IAG totalement flexible, mais chaque progrès (notamment en apprentissage continu) nous rapproche de cet objectif. Avec les avancées technologiques qui s’accélèrent, ce futur pourrait arriver beaucoup plus vite que prévu.

Intelligence artificielle : l’IA Act, entre ambition et concrétisation (article paru dans Forbes le 2 février 2025)

Le 1er août 2024 restera dans l’histoire comme le jour où l’Europe a marqué un tournant dans la régulation des technologies d’intelligence artificielle. L’IA Act, premier cadre législatif dédié à cette révolution technologique, est à la fois une opportunité immense et un défi colossal. Alors que l’échéancier réglementaire se précise, il est urgent de souligner les points cruciaux pour que cette ambition ne se transforme pas en frein à l’innovation.

L’IA Act propose une classification des systèmes d’IA selon leur niveau de risque : inacceptable, élevé, limité ou minime. Cette approche vise à protéger les droits fondamentaux tout en encourageant l’innovation. Les systèmes à risque inacceptable, comme la reconnaissance biométrique en temps réel à des fins répressives, sont interdits, tandis que les systèmes à haut risque doivent se conformer à des normes strictes.

Cependant, cette classification soulève des questions. Quels critères précis définissent un système « à haut risque » ? Comment éviter que des interprétations divergentes ne créent des blocages ? Pour que ce cadre devienne une opportunité, il est essentiel que les standards harmonisés, normes techniques développées par des organismes de normalisation pour faciliter la conformité aux exigences légales, soient disponibles dès cette année

L’Europe doit ainsi concilier protection et compétitivité, sous peine de dissuader des entreprises d’innover dans un environnement perçu comme trop contraignant.

La transparence imposée par l’IA Act, notamment sur les données utilisées pour entraîner les modèles, est une avancée importante. Elle garantit la confiance des utilisateurs et prévient les abus. Toutefois, cette exigence pourrait entrer en conflit avec la protection des secrets commerciaux, un élément clé pour préserver la compétitivité des entreprises européennes.

Le défi consiste à éviter que cette transparence n’expose les acteurs européens à une concurrence déloyale, notamment face à des entreprises non soumises à des cadres aussi stricts. Pour y parvenir, l’Europe doit mettre en œuvre des solutions comme les « bacs à sable » réglementaires. Ces environnements permettront de tester des technologies en conditions réelles tout en respectant les exigences légales.

Par ailleurs, il est crucial que les sanctions prévues – jusqu’à 35 millions d’euros ou 7 % du chiffre d’affaires mondial – soient appliquées avec discernement. Une régulation punitive risque de freiner les initiatives là où un accompagnement favorise l’adhésion et l’innovation.

L’article 4 de l’IA Act impose une obligation de formation pour les organisations utilisant l’IA. Cette mesure, qui entre en vigueur en février 2025, est un levier essentiel pour garantir une adoption responsable et efficace de ces technologies.

Cependant, la préparation des entreprises reste insuffisante. Une formation bien conçue ne doit pas être perçue comme une contrainte, mais comme une opportunité stratégique. Elle permet d’aligner les équipes techniques, juridiques et managériales autour d’une vision commune, tout en renforçant la confiance des décideurs.

Sensibiliser aux avantages et aux enjeux du règlement est une clé pour surmonter les réticences et encourager une adoption proactive de l’intelligence artificielle.

Pour que l’IA Act tienne ses promesses, une gouvernance claire et efficace est indispensable. La coordination entre le Bureau européen de l’IA et les autorités nationales, prévues pour août 2025, devra éviter les doublons et garantir une application harmonisée. Cette gouvernance devra également être agile pour s’adapter à l’évolution rapide des technologies, comme les IA génératives. Ces technologies, qui peuvent être utilisées à des fins variées, posent des défis nouveaux en matière de régulation. Un cadre flexible permettra de répondre aux besoins sans freiner l’innovation.

Enfin, l’Europe doit assumer son rôle de leader mondial, non seulement en soutenant ses entreprises, mais aussi en imposant ses standards au niveau international.

L’intelligence artificielle n’est pas seulement une avancée technologique. C’est une transformation sociétale majeure qui exige une régulation capable d’inspirer confiance tout en favorisant le progrès. À nous, Européens, de prouver que réguler ne signifie pas freiner, mais guider avec ambition et pragmatisme.

Se Former à l’Intelligence Artificielle : une nécessité tout comme l’apprentissage de l’anglais ?

Il fut un temps où l’anglais était vu comme un simple atout pour les professionnels du monde des affaires. Rapidement, il est devenu une compétence indispensable, un sésame pour collaborer, négocier, innover et accéder aux opportunités internationales. Aujourd’hui, l’Intelligence Artificielle (IA) semble suivre un chemin similaire : ce qui était hier une compétence réservée aux experts devient désormais une nécessité pour tous.

Dans les années 1980-2000, les entreprises ont réalisé qu’elles ne pouvaient plus se développer à l’international sans maîtriser l’anglais. Savoir parler anglais n’était plus seulement une compétence technique pour traducteurs ou interprètes, mais une compétence de base pour toute personne travaillant dans l’économie mondialisée, du cadre dirigeant au commercial.

L’anglais a permis l’accès à l’information (recherche, études de marché), a facilité la communication directe avec les clients, partenaires et fournisseurs et a également permis aux entreprises de s’intégrer dans des réseaux professionnels mondiaux. Ne pas parler anglais signifiait rester en marge des grandes dynamiques économiques.

Aujourd’hui, l’Intelligence Artificielle est en train de devenir ce qu’était l’anglais à la fin du XXème siècle : un langage universel de fonctionnement et de création de valeur. La compréhension de l’IA n’est plus optionnelle ; elle devient une clé de survie et de croissance.

Comme pour l’anglais, l’IA offre de nombreux avantages. Maîtriser l’IA permet de mieux exploiter les données, produire de nouvelles connaissances et anticiper les évolutions du marché. Savoir bien communiquer avec les assistants virtuels permet de disposer de véritables partenaires de travail. Les écosystèmes innovants, des startups, des multinationales, des administrations… tous intègrent des briques d’IA. Comprendre l’IA permet de s’insérer dans ces dynamiques.

Apprendre l’anglais ne signifiait pas devenir professeur de langue. De même, apprendre l’IA ne signifie pas devenir data scientist ou ingénieur en Machine Learning mais d’en maîtriser les bases pour poser les bonnes questions aux experts techniques, savoir bien communiquer avec les IA génératives comme ChatGPT ou d’autres dans son métier et anticiper les évolutions de son secteur grâce à l’automatisation et les algorithmes prédictifs.

Ainsi, apprendre l’IA, c’est gagner en autonomie, renforcer sa capacité d’innovation et sécuriser son employabilité.

Dans les années 1990, un cadre qui ne parlait pas anglais voyait sa carrière freinée. En 2030, un professionnel qui ne comprendra pas les bases de l’IA sera confronté aux mêmes limites, de la difficulté à comprendre les nouveaux outils et modes de travail à l’incapacité à participer aux projets d’innovation. Se former à l’IA, c’est donc éviter l’obsolescence professionnelle et rester acteur des transformations.

L’histoire se répète : comme l’anglais hier, l’intelligence artificielle est une langue qu’il faut apprendre pour pouvoir agir, innover et réussir dans le monde professionnel de demain.

Se former à l’IA n’est pas réservé aux experts en informatique. C’est une nécessité pour tous les métiers, toutes les fonctions et tous les secteurs. Comme pour l’anglais, il ne s’agit pas d’être parfait, mais d’être opérationnel, confiant et actif dans ce nouvel environnement. Parler « IA » demain sera aussi naturel que de parler anglais. Et ceux qui auront investi tôt dans cette compétence auront une longueur d’avance décisive.